Die Vorteile künstlicher Intelligenz liegen auf der Hand. Umgekehrt steigen aber auch Haftungs- und Reputationsrisiken, wenn Qualitätssicherung, Lizenz- und Nutzungsrechte oder Transparenzpflichten vernachlässigt werden. Daher sollte der Workflow frühzeitig auf „Responsible AI“ ausgerichtet werden. Dazu gehören klaren Strukturen für die Qualitätssicherung über den ganzen Prozess hin, Prompt-Governance, regelmäßige Bias-Audits und korrekter Kennzeichnung. Achtet man auf einen verantwortungsvollen Einsatz, unter Rücksicht der genannten Punkte, kann generative KI zu einem echten Wettbewerbsvorteil werden.

Die nahezu unbegrenzten Möglichkeiten generativer KI-Tools sorgen zu Recht für große Begeisterung. Gleichzeitig rufen sie aber auch viele Sicherheitsfragen auf. Sensible Kundendaten können in öffentliche Modelle gelangen und so, Datenschutz und Geschäftsgeheimnisse gefährdet. Die KI-Systeme spiegeln oft Bias aus Trainingsmaterial wider und können halluzinieren.

Hinzu kommt die urheberrechtliche Dimension, Klagen von Medienunternehmen und Kreativschaffenden gegen KI-Dienste sind keine Seltenheit mehr. Die Unternehmen OpenAI und Microsoft wurden im Dezember 2023 von der New York Times verklagt, und am 11. Juni 2025 wurde gegen Midjourney von Disney und Universal eine Klage erhoben.

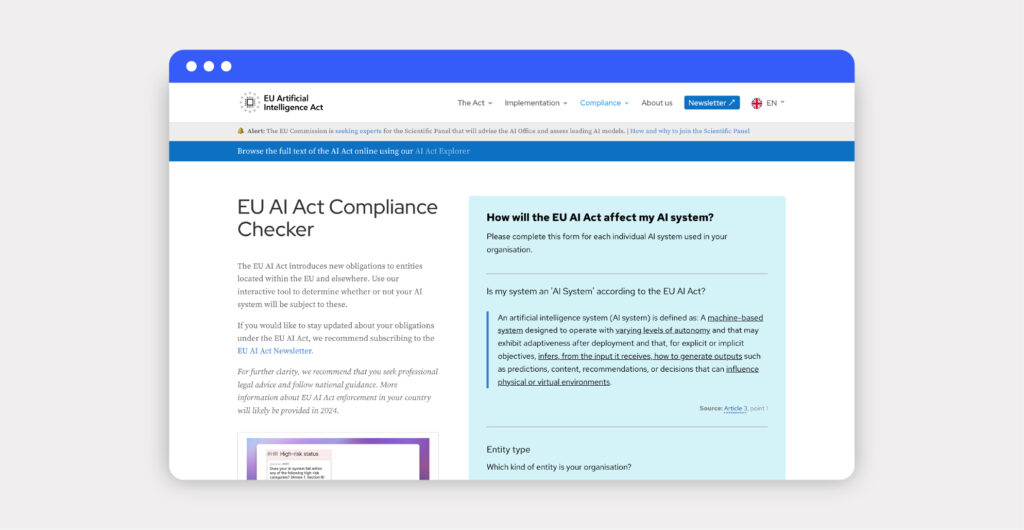

Wenn der Fortschritt generativer KI ohne Regulierung weiterläuft, werden die Risiken in gleichem Tempo mitwachsen und genau daran knüpft der EU AI Act an. Der risikobasierte Ansatz verpflichtet Anbieter und Anwender generativer Systeme zu Sicherheitsprüfungen, nachvollziehbaren Trainingsdaten und maschinenlesbaren Kennzeichnungen.

Der EU Artificial Intelligence Act ist eine europäische Verordnung über künstliche Intelligenz (KI) und die weltweit erste ihrer Art, von einer wichtigen Regulierungsbehörde. In dieser werden Anwendungen von KI in drei Risikokategorien eingeordnet. In der ersten Kategorie werden alle Anwendungen und Systeme beschrieben, die ein inakzeptables Risiko darstellen. Ein Beispiel für ein solches inakzeptables Risiko wäre z.B. das in China vom Staat betriebene Social Scoring, in dem Bürger:innen auf Basis von Verhalten, Aussagen und Taten bewertet werden. In der zweiten Kategorie werden alle Anwendungen und Systeme mit einem hohem Risiko beschrieben, wie z.B. ein Tool zum Scannen und Bewerten von Lebensläufen, solche Anwendungen unterliegen besonderen rechtlichen Anforderungen. In der dritten und letzten Kategorie, fallen alle Anwendungen die nicht ausdrücklich verboten oder als risikoreich eingestuft werden, diese bleiben weitestgehend unreguliert.

Darüber hinaus enthält der EU AI Act aber auch allgemeine Bestimmungen, die sich auf den Einsatz von generativer KI auswirken. Für Kreative, die in ihrem Alltag KI einsetzen möchten oder dies schon tun, sind vor allem die Artikel 4 und 50 von hoher Relevanz.

Quelle: Future of Life Institute (2025), www.artificialintelligenceact.eu

In den Artikeln 4 und 50 des EU AI Acts werden Anforderungen an die KI-Kompetenz und Transparenzpflicht festgelegt. Gemäß Artikel 4 müssen alle Personen, die mit dem Betrieb oder der Nutzung eines KI-Systems befasst sind, über die nötige KI-Kompetenz verfügen. Dafür verantwortlich sind sowohl die Anbieter als auch die Betreiber. Überträgt man diese Vorgabe auf eine Agentur, liegt es in der Pflicht der Geschäftsführung dafür zu sorgen, dass das gesamte Personal ausreichend KI-kompetent ist.

Bei den Vorgaben zur Transparenzverpflichtung geht es im Grunde darum, dass KI-Systeme und KI-generierte Inhalte (Audio-, Bild-, Video- und Textmaterial) spätestens bei der ersten Interaktion mit einer natürlichen Person als solche erkennbar sind.

Diese Kennzeichnung muss in allen Formaten für Nutzer:innen sichtbar sein und zudem in einem maschinenlesbaren Format hinterlegt werden. Ausgenommen sind lediglich Anwendungsfälle, in denen KI-Systeme eine reine Hilfsfunktion übernehmen oder die von Anwender:innen bereitgestellten Daten nicht wesentlich verändern. Im Zweifelsfall ist es dennoch ratsam, auch in diesen Fällen im Sinne der Transparenz einen Hinweis zu ergänzen.

Anbieter und Betreiber von KI-Systemen ergreifen Maßnahmen, um nach besten Kräften sicherzustellen, das alle Personen, die mit einem KI-System interagieren (Betrieb, Nutzung), über ausreichend KI-Kompetenz verfügen.

Anbieter von KI-Systemen, die für eine direkte Interaktion mit einer natürlichen Person bestimmt sind, müssen die betroffene natürliche Person darüber informieren, dass sie mit einem KI-System interagieren. KI-generierte Inhalte (Audio, Bild, Video, Text und Deep Fakes) müssen maschinenlesbar und für Nutzer:innen sichtbar gekennzeichnet werden.

Darüber hinaus werden im Artikel auch Richtlinien für den Einsatz von KI zu Erkennung von Emotionen und der Verarbeitung von biometrischen Informationen definiert, die aber in einem Agentur-Alltag keine Anwendung finden sollten.

Adobe-Apps setzen bei Firefly-Inhalten die C2PA-Credentials bereits automatisch. In Photoshop, Premiere und einer Reihe weiterer Apps, kann zudem die Option „Content Credentials anhängen“ aktiviert werden.

Verfügt man über die nötigen technischen Vorkenntnisse, können C2PA-Credentials auch über die CAI open source SDK (software development Kit) erstellt, geprüft und angezeigt werden. Unterstützt eurer Tool (noch) keine C2PA-Credentials, kann als Ersatz für ein maschinenlesbaren Hinweis die Kennzeichnung auch über die IPTC-Daten erfolgen.

Wurden Texte vollständig von einer KI generiert oder stark umgeschrieben, muss nach Artikel 50 des EU AI Act ein Transparenzhinweis gesetzt werden. Die Kennzeichnung muss maschinenlesbar und für Nutzer:innen sichtbar sein.

Rechtschreibkorrekturen oder Kürzungen durch eine KI gelten nach dem EU AI Act als assistive Standardbearbeitung und benötigen keine Kennzeichnung. Auch in solchen Fällen empfiehlt es sich jedoch als Best-Practice, einen Disclaimer zu ergänzen.

Responsible AI ist nicht etwas, das einfach ans Ende unserer Arbeitsprozesse angehängt werden kann. Es muss von Grund auf als fester Bestandteil unserer Workflows aufgebaut werden. Dafür braucht es klare Rollen, eine strikte Qualitätssicherung und eine korrekte Dokumentation von Datenquellen und Output. Der EU AI Act bietet eine Grundlage hinsichtlich Datenschutz, Urheberrecht und Transparenz, an die wir uns als Agenturen zuverlässig orientieren können.

Mit diesem Artikel möchten wir Aufmerksamkeit dafür schaffen, warum ein Verantwortungsvoller Umgang mit KI wichtig ist. Dabei handelt es sich in keiner Weise um eine Rechtsberatung.

Erzähl uns von deinem Projekt. Gemeinsam schaffen wir eine Marke, die Menschen erreicht.